As we know, AirDrop is Apple’s proprietary protocol.

However, it is possible to use AirDrop on non-Apple devices and enable those devices to work with Apple devices.

Of course, there are some prerequisites and limits.

I’m specifically using Android as an example in this article.

At the time of writing, I haven’t finished the tool’s development.

Background

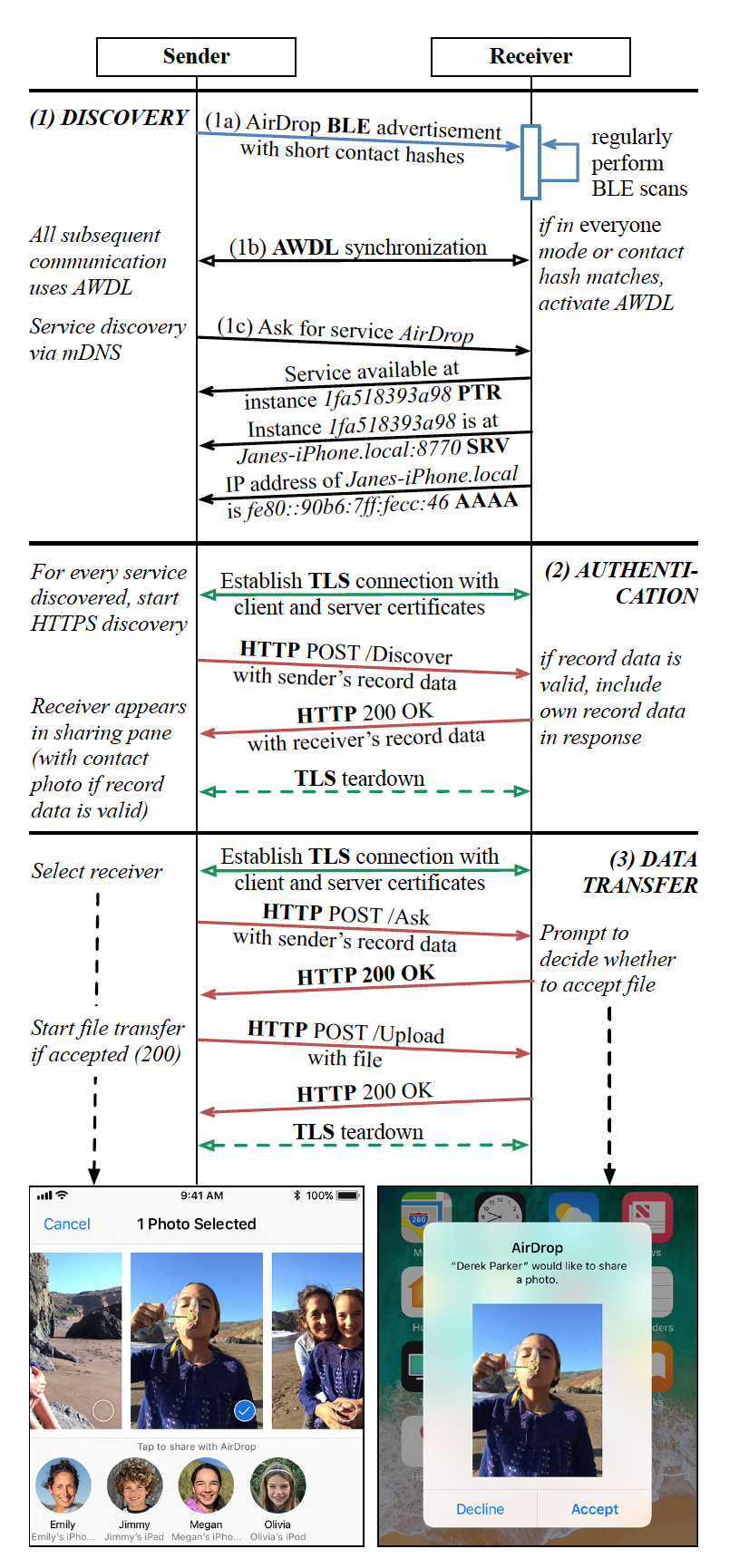

References to papers published by Secure Mobile Networking Lab, we can fully understand how AirDrop works:

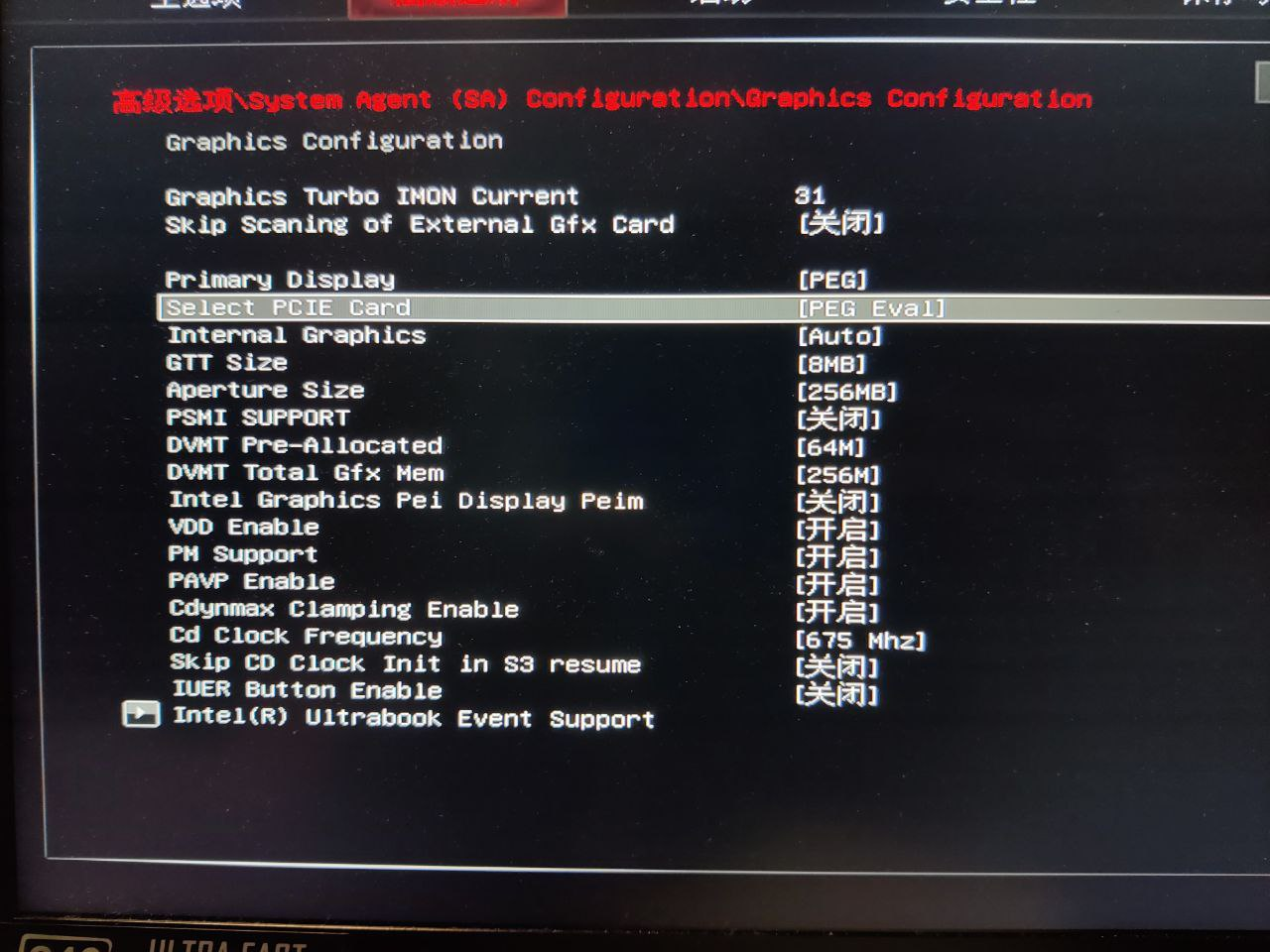

The AirDrop’s web service runs at application layer. And AWDL operates at the data link layer and the physical layer.

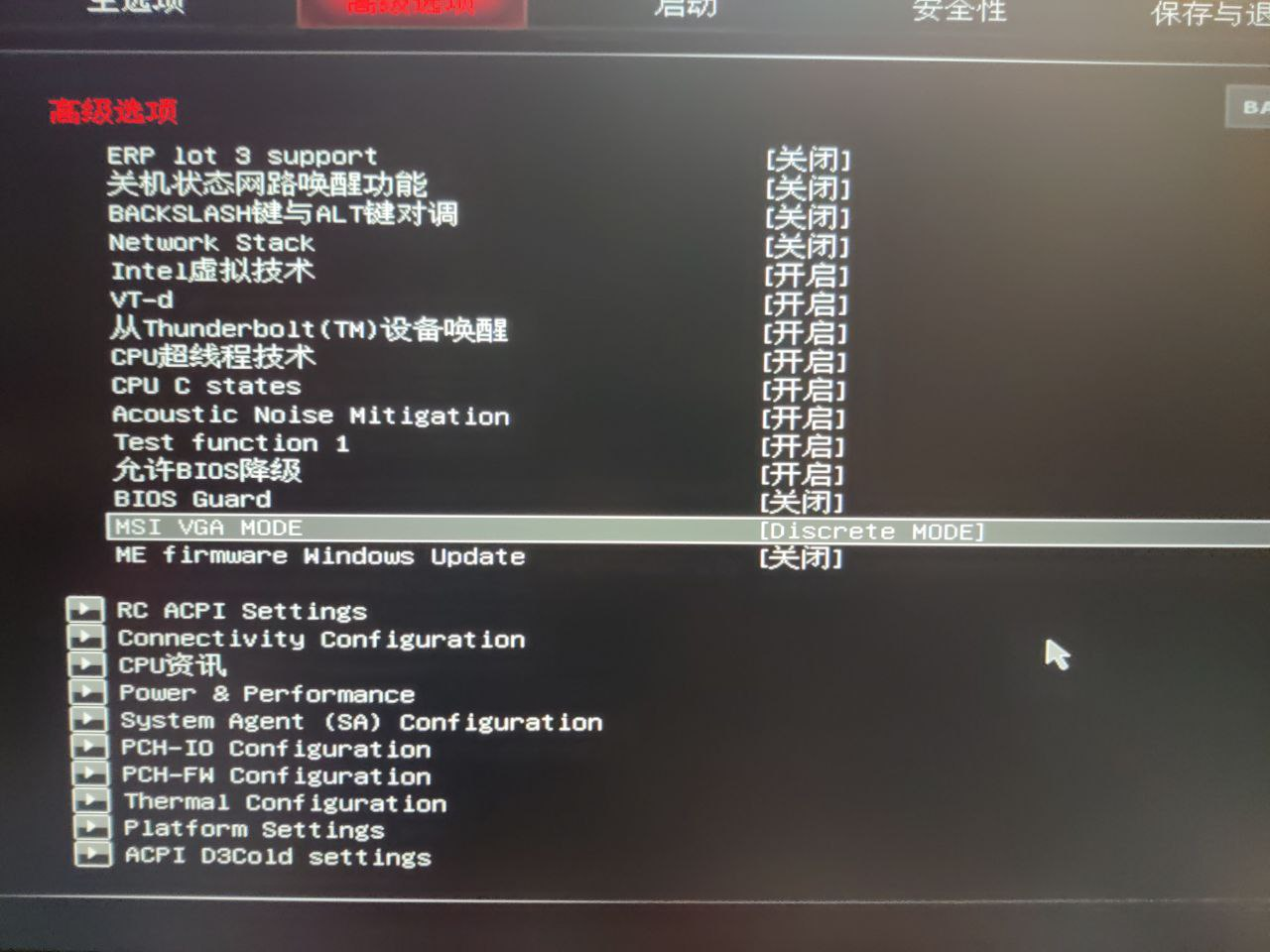

Besides, I found that on macOS, the receiver registers a mDNS service not only on the AWDL interface (awdl0) but also on all network interfaces (lo0, en0) after discovering a BLE advertisement.

On macOS we can enable the capability to browse all interfaces. With it on, sharing via AirDrop will discover devices on non-AWDL interfaces.

Although the AWDL protocol is very complicated and difficult to implement, AirDrop does not absolutely rely on AWDL on macOS. So we can replace AWDL with any other Ethernet without looking into it.

Limitation

- Mac-only

- AirDrop in

Everyonemode - LAN-only

- Only if

BrowseAllInterfacesis turned on and Ethernet (non-WiFi) is connected, sharing via AirDrop will be able to discover devices on the LAN.

Note: even though condition 4 is not fulfilled, other devices can AirDrop to the Mac

Implementation

Just some samples

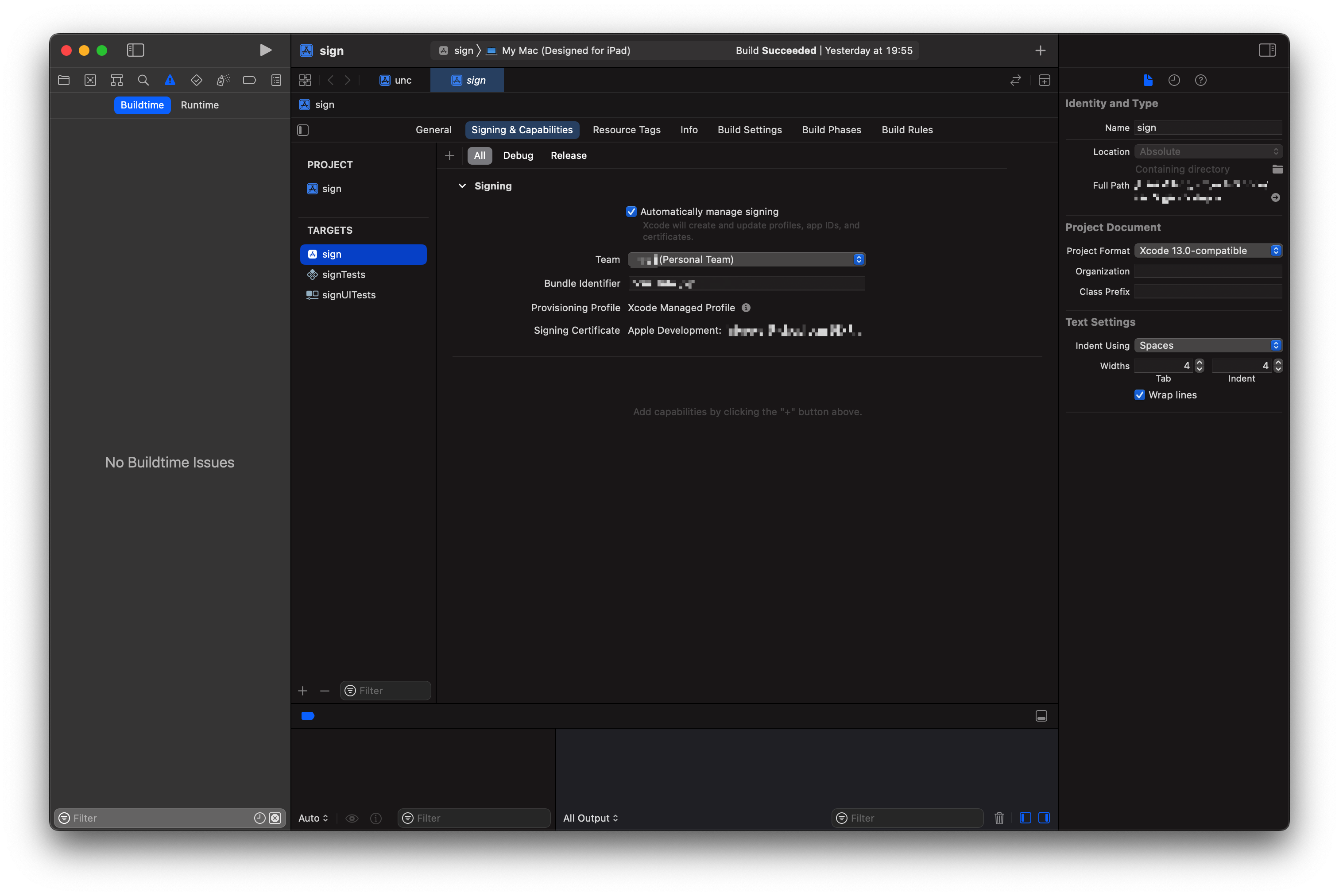

Enable BrowseAllInterfaces

Run the following command:

1 | defaults write com.apple.NetworkBrowser BrowseAllInterfaces 1 |

Meanwhile, you can turn it off by:

1 | defaults write com.apple.NetworkBrowser BrowseAllInterfaces 0 |

BLE Advertise

Use a Bluetooth LE Advertisement to activate Mac’s AirDrop.

1 | package com.i1nfo.anydrop |

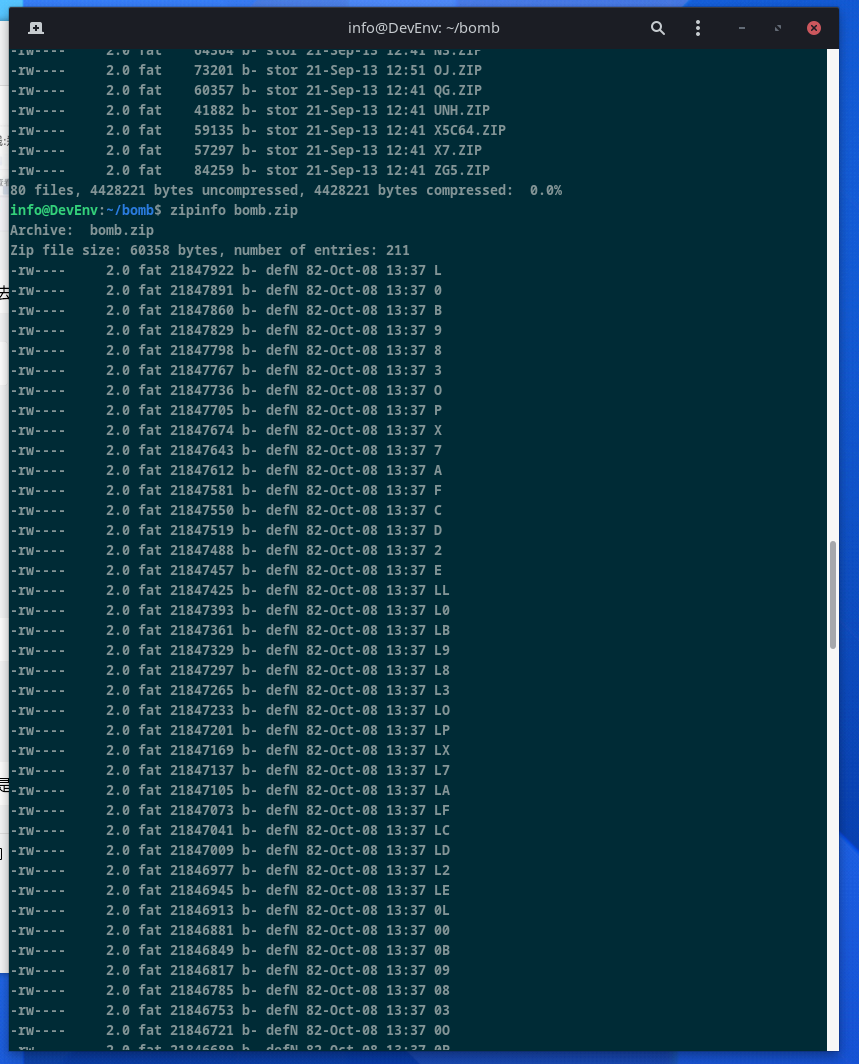

Discover AirDrop services by mDNS

1 | package com.i1nfo.anydrop |

Send HTTP Requests

Send request to AirDrop files.

TODO

Register a AirDrop service

Register a mDNS service and create a HTTP server to receive files.

TODO

References

- Paper: Milan Stute, Sashank Narain, Alex Mariotto, Alexander Heinrich, David Kreitschmann, Guevara Noubir, and Matthias Hollick. A Billion Open Interfaces for Eve and Mallory: MitM, DoS, and Tracking Attacks on iOS and macOS Through Apple Wireless Direct Link. 28th USENIX Security Symposium (USENIX Security ’19), August 14–16, 2019, Santa Clara, CA, USA. Link

- Blog: https://bakedbean.org.uk/tags/airdrop/

- Code: https://github.com/seemoo-lab/opendrop